Dieser Artikel ist als Hilfestellung für Schüler/innen gedacht, die kurz vor dem Abschluss stehen und sich beruflich in Richtung Spiele-Entwicklung orientieren wollen.

Wenn eine professionelle Karriere im Bereich Game- (oder allgemein Software-)Entwicklung angestrebt wird, könnte ein Studium in diesem Bereich in Frage kommen. Ein Studium oder eine ähnliche spezialisierende Fachausbildung ist meines Erachtens einer der besten Wege, um professionelles Fachwissen zu erlangen und zudem eine für den Arbeitsmarkt relevante Qualifikation zu erreichen.

Die Professoren und Dozenten verfügen über entsprechendes Expertenwissen, der Studienplan sieht ein Durchlaufen aller relevanten Inhalte vor und es gibt viele praktische Projekte. Durch die persönliche Betreuung können auch individuelle Fragen geklärt werden. Ein Studium hat außerdem die angenehme Eigenschaft, dass man wegen der hohen fachlichen Spezialisierung mit vielen anderen Studenten zusammen ist, die sich für die selben Dinge interessieren.

Wie jeder Beruf ist auch ein Studium nicht für jeden geeignet. Im Zweifelsfall kann man es aber auch relativ einfach ausprobieren und ggf. wieder abbrechen.

Studiengänge

Welche Studienrichtung gewählt wird, hängt in erster Linie von den eigenen Interessen und langfristigen Ziele ab. Es gibt im Wesentlichen drei Arten von Studienprogrammen, die im Bereich Spieleentwicklung in Frage kommen:

1. Reine Informatik

Sehr allgemein und eine passende Vorbereitung für computer-technische Jobs jeder Art.

Spiele-Projekte kommen hier vor, aber meist nur am Rande. Wenn einem Spiele-Entwicklung wichtig ist, kann dieses Feld zu einseitig sein, weil wichtige Grundlagen, z.B. die der künstlerischen Gestaltung, im reinen Informatik-Studium fehlen.

Reine Informatiker arbeiten später meist auch rein am Code. Informatik ist beruflich sehr zukunftssicher, erfordert aber viel technisch-abstraktes Arbeiten. Ein Bachelor-Informatik-Studium dauert etwa 3-4 Jahre.

2. Reines Game-Development

Spezialisierung auf reine Spiele-Entwicklungs-Jobs. Kann auch als spätere Zusatzfortbildung in Frage kommen.

Hier sollte man sorgfältig prüfen, welche Art von Schule gewählt wird und wie genau sie ausgerichtet ist. In den letzten Jahren sind viele Games-Schulen entstanden, die rein Spiele-Entwicklung behandeln. Man bekommt hier auch einen sehr guten Start in die Games-Welt, ist aber relativ stark auf Spiele-Entwicklung festgelegt.

Obwohl man mit einem solchen Abschluss vermutlich auch keine all zu großen Probleme haben dürfte, einen Job (ggf. auch außerhalb Games) zu bekommen, liegt die Gefahr hierbei darin, sehr auf Spiele-Entwicklung festgelegt zu sein, weil die breitere Ausrichtung fehlt.

Eine Games-Ausbildung an einer privaten Schule dauert ca. 1-2 Jahre und kann mit Studiengebühren verbunden sein.

3. Multimedia (Mischung aus Informatik und Design)

Ein traditionelles Studium (wie reine Informatik), aber mit der Ausrichtung auf interaktive Medien.

Hier spielt der künstlerische Aspekt eine große Rolle. Multimedia-Studiengänge wurden mit dem Ziel konzipiert, dass die Studenten am Schluss ‚Programmierer, die auch etwas von Gestaltung verstehen‘ oder ‚Künstler, die Ideen auch technisch umsetzen können‘ herauskommen.

Spiele-Projekte kommen hier an verschiedenen Stellen vor, es werden aber auch andere Projekte bearbeitet, die ebenfalls multimedialen Charakter haben. Da mir die Mischung aus Technik und Gestaltung immer sehr am Herzen lag, habe ich selbst Multimedia studiert und unterrichte heute in diesem Bereich. Daher ist diese Variante natürlich mein Favorit. ?

Langfristig denken

Generell wird man mit allen drei Ausbildungsrichtungen später Jobs bekommen, da sie alle eine gemeinsame technische Basis haben, die sich auch auf andere Bereiche übertragen lässt.

Spiele-Entwicklung ist sogar eher umfangreich, da es das Zusammenspiel vieler einzelner Teilbereiche erfordert. Es gibt viele Jobs bei denen quasi ein Teilbereich dessen was man bei der Spiele-Entwicklung macht, genügt, so dass man tendenziell eher zu viel als zu wenig weiß.

Reine Spiele-Entwicklung würde ich von den drei genannten Richtungen dennoch als die Option mit dem größten Risiko von Einschränkungen einschätzen.

Für die Entscheidung, welchen Job man langfristig später mal macht, ist die Berufserfahrung, die man nach dem Studium sammelt, deutlich relevanter. Während des Studiums und in den ersten Jobs ist man noch relativ frei, den eigenen Weg zu finden und auch noch öfter mal zwischen Varianten zu wechseln. Das Risiko hier jetzt also etwas vollkommen falsches zu wählen halte ich für relativ gering.

Entscheidungshilfe: Was ist mir wichtig?

Wer sich unsicher ist, in welche Richtung der Weg führen soll, dem würde vorschlagen, sich über die bei 1-3 beschriebenen Aspekte Gedanken zu machen. Das sind in erster Linie:

- Wie wichtig ist der gestalterisch-künstlerische Aspekt?

- sehr wichtig → Multimedia

- nicht wichtig → Informatik

- Wie wichtig ist die Flexibilität, um später leicht auf nicht-Spiele-Bereiche ausweichen zu können?

- wichtig → Informatik oder Multimedia

- weniger wichtig → Game-Development

Was lernt man in Studiengängen neben Programmieren?

Informatik sowie Multimedia decken in der Regel essentielle Grundlagen der Computertechnik ab. Dazu gehört vieles, das nur indirekt mit Programmieren zu tun hat, wenngleich die Programmierung natürlich DAS Werkzeug zur Steuerung ist und damit auch immer im Mittelpunkt steht.

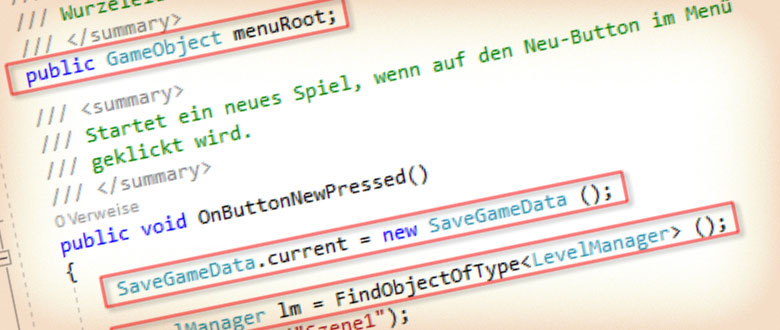

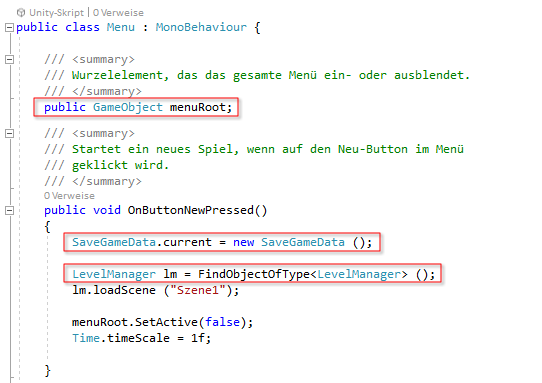

An den vielen Hochschulen ist es dabei übrigens so, dass eher das Grundverständnis der Softwaretechnik vermittelt wird und eine konkrete Programmiersprache eher beispielhaft zum Einsatz kommt. Das ist wichtig, um später selbstständig neue Programmiersprachen erlernen zu können.

Programmierung deckt zudem viele Teilbereiche ab. Darunter fallen die Code-Formulierung selbst, aber auch Techniken zur Berechnung von Ergebnissen, wie z.B. Grafiken oder Datenauswertungen oder die Verwendung von Datenbanken. Diese Bereiche knüpfen meist an andere Bereiche an, wie z.B. Mathematik.

Es gibt auch Grundlagenfächer, die sich mit der generellen Funktionsweise von Computern, z.B. auch auf Hardware-Ebene, befassen. Wie viel man davon braucht, hängt vom späteren persönlichen Werdegang ab. Bei Mischstudiengängen wie Multimedia kommen noch andere Fächer hinzu, wie z.B. Zeichnen, 3D-Gestaltung, Animation usw.

Konkrete Studieninhalte

Du kannst übrigens ganz konkret nachlesen, was in den einzelnen Studiengängen bearbeitet wird, in dem Du Dir die „Studien- und Prüfungsordnungen“ und das „Modulhandbuch“ der Studiengänge ansiehst, die in der Regel öffentlich sind.

Beispiele der Hochschule Augsburg:

Bachelor Interaktive Medien (=Multimedia)

Bachelor Informatik

Universität oder Hochschule?

Eine Entscheidung kann auch noch in der Wahl zwischen Universität oder Hochschule liegen. Die Universitäten sind meist theoretischer und näher an der Wissenschaft, die Hochschulen praxisorientierter. Sieh Dir dazu am besten einfach auch die Webseiten infrage kommender Schulen an.

Zudem bieten viele Ausbildungsstätten übrigens auch Studienberatungen an, wo man hingehen und konkret besprechen kann, was die Studiengänge anbieten und was ggf. für einen selbst geeignet wäre.

Wo finde ich Schulen für Spiele-Entwicklung?

Die Seite www.gamesmap.de enthält eine Karte mit Games-Schulen in Deutschland.

Sehr viele Ergebnisse liefern auch Google-Suchen, nach Begriffen wie Game Development Studium, oder Studium Game Bachelor.

Zusammenfassung

Für sehr viele technische Berufe ist ein Hochschul- oder Universitätsstudium erforderlich. Für Schüler, die sich für Berufe im Bereich Computerspielentwicklung interessieren, kommen in etwa drei Richtungen in Frage: reine Informatik, reines Game-Development, Multimedia als Mischform. Um in der kurzlebigen Technikwelt in Zukunft flexibel zu bleiben, empfehle ich eher allgemein ausgerichtete Studiengänge. Die konkreten Studieninhalte sind oft im Internet öffentlich einsehbar. Als Entscheidungshilfe sollte man sich bewusst mit der Frage auseinandersetzen, welche Inhalte einem persönlich wichtig sind.