Rechner für Blender und Unity bauen

So funktioniert diese Serie:

Es gibt eine Video- und eine Text-Version. Am Anfang jedes Artikels steht das Video, darunter die Text-Version des jeweiligen Abschnitts. Am Ende der Seite findest Du einen Link zum jeweils nächsten Teil. Wenn Du nur die Videos sehen willst, kannst Du das auch über diese Youtube-Playlist tun.

Inhalt

Teil 1 – Einleitung & Überblick

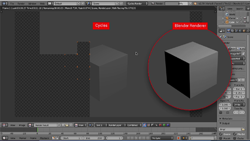

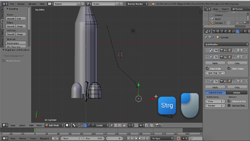

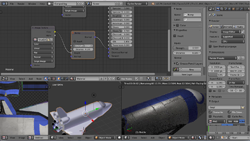

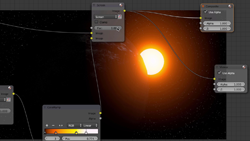

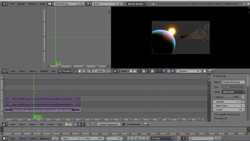

Für jede Form von Softwareentwicklung werden leistungsfähige Entwicklungsrechner benötigt. Besonders hoch sind die Anforderungen jedoch bei aufwendigen Techniken wie zum Beispiel dem Rendern von Szenen, die auf 3D-Simulation basieren. Blenders „Cycles“-Renderer basiert essentiell auf Lichtsimulationen, wodurch zwar sofort ansehnliche Ergebnisse entstehen, die Rechenzeit aber schon bei vergleichsweise einfachen Szenen schnell ansteigt.

Es liegt nicht nur an der Hardware

Um komplexe Berechnungen durchzuführen, ist eine leistungsfähige Hardwareausstattung hilfreich. Dennoch sei vorweg genommen, dass die Geschwindigkeit mit der Blender ein Bild berechnet, auch wesentlich von anderen Faktoren abhängt.

Auch auf Hochleistungshardware kann das Rechnen viel Zeit verbrauchen, wenn es sich um eine komplexe Szene handelt und die Einstellungen nicht optimiert wurden. Das heißt ganz allgemein auch, dass ein Projekt mit Problemen im Aufbau auf besserer Hardware nicht automatisch schneller berechnet werden kann. Außerdem ist es auch ein Stück weit normal, dass das Berechnen aufwändiger Szenen sehr lange dauert. Bei Pixar z.B. dauert das Berechnen eines einzigen Film-Bildes 50 Stunden oder noch erheblich länger und das, obwohl dort hochoptimierte und sehr leistungsfähige Systeme zum Einsatz kommen.

Rendern mit besserer Hardware beschleunigen

Der allgemeine Trend bei der Anschaffung von Hochleistungs-PCs fürs Rendering geht dahin, keine fertigen Systeme zu kaufen, sondern die idealen Komponenten selbst zusammen zu stellen. Dabei gibt es aber viele Unterschiede im Detail zu beachten, weil verschiedene Hardware nur ihre volle Leistung bringen kann, wenn alles richtig zusammenspielt. Für Blender und Cycles wird als Prozessor Intel gegenüber AMD meist bevorzugt und bei der Grafikkarte können einige Funktionen (CUDA) nur von Nvidia-Karten genutzt werden.

Welche Hardware ist die richtige?

Da ich selbst auch kein Experte beim Zusammenbau von Hardware bin, habe ich zunächst einige Recherche betrieben. Das Video von Tobi Lijsen zu diesem Thema gibt einige gute Anregungen, ist hinsichtlich der konkreten Komponenten aber nicht mehr ganz aktuell. Daher bin im weiteren Verlauf auf eine amerikanische Ratgeber-Seite gestoßen, die Konfigurationen für Gaming- und Render-PCs vorstellt und diese auch immer wieder aktualisiert.

Vom Ratgeber ausgehend habe ich eine Liste von Komponenten für einen Blender-Render-PC zusammengestellt. Einige Bestandteile sind in Europa nicht verfügbar und wurden daher von mir mit Alternativen ersetzt.

Einkaufsliste

Die im folgenden beschriebenen Bestandteile des Render-PCs liegen in der mittleren Preisklasse bei insgesamt knapp unter 2000 Euro. Nicht enthalten sind folgende Komponenten, die ich von meinem bestehenden Rechner übernommen habe und daher nicht nochmal kaufen musste:

- Maus und Tastatur (USB), ca. 35€

- Monitor, ich verwende den ASUS VG248QE^. ca. 280€

Achtung: Dein Monitor braucht unbedingt einen HDMI-Anschluss, da die unten aufgelistete Grafikkarte keinen DVI oder älteren Ausgang mehr hat. - HDMI-Kabel^, sofern nicht schon vorhanden, ca. 6€.

- DVD-Laufwerk, z.B. LG GH24NSD1.AUAA10B DVD-R/RW+R/RW Bulk Sata Schwarz^ oder ähnlich, ca. 13€, für die Treiber-Installationen von den Setup-DVDs erforderlich!

- Optional: zusätzliche interne Festplatte, ca. 90€.

Hier habe ich noch eine alte WD5000AAKS^, die für den Moment ausreicht. Eine zusätzliche Platte ist gut als Datenspeicher, für den Aufbau und den Start des Rechners aber nicht erforderlich.

Neue Komponenten

Gehäuse

Netzteil/Strom

Mainboard

MSI X470 GAMING PLUS^

ca. 138€

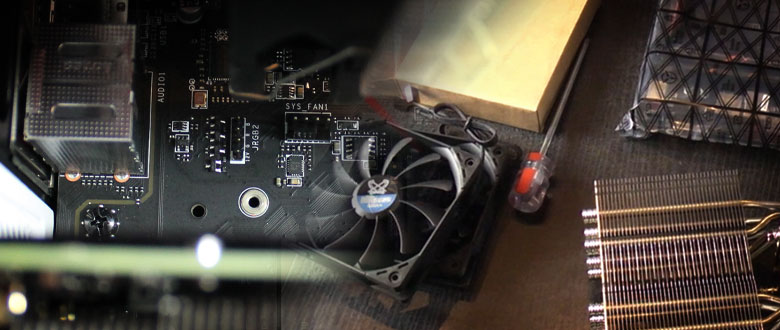

Prozessorkühler

Scythe CPU Kühler Mugen 5 PCGH Edition (SCMG-5PCGH)^

ca. 59€

Dieser spezielle Prozessorkühler hat einen riesigen Wärmeleiter und zwei Ventilatoren. Dieser separate Kühler ist für den Aufbau nicht zwingend erforderlich, zumal der Lieferumfang des Prozessors selbst einen kleinen ’normalen‘ Kühler enthält.

Prozessor

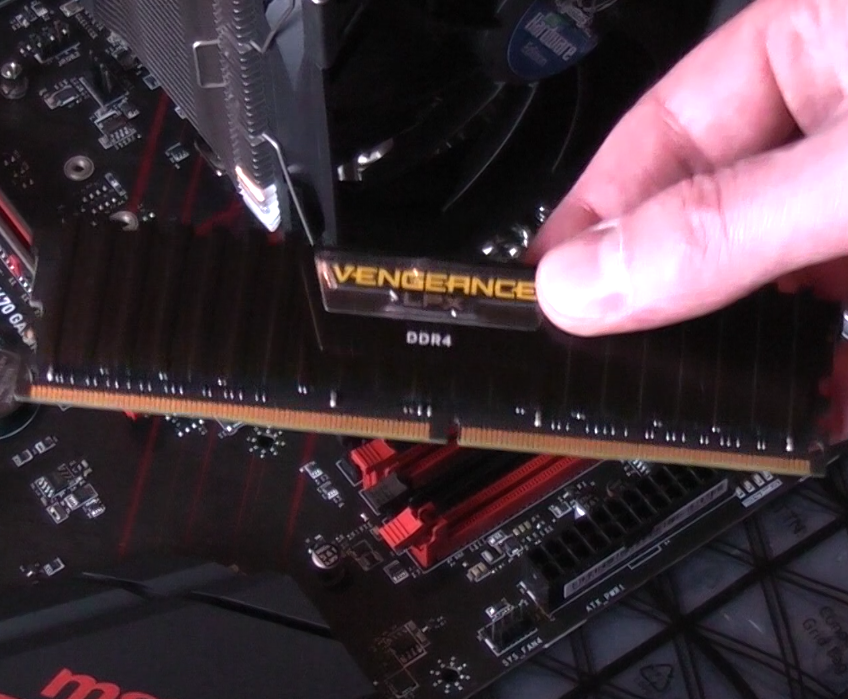

Arbeitsspeicher (32 GB DDR4)

Interne Hochgeschwindigkeitsfestplatte (SSD)

Grafikkarte

Gigabyte 8GB GeForce RTX 2070^

ca. 529€

Windows 10 Lizenz

… auf einem bootfähigen USB-Stick^ (min. 8GB Kapazität nötig). Du kannst einen Window 10-Installationsstick mit dem Media Creation Tool erstellen. Ansonsten werden auch Windows 10-Lizenzen im Handel angeboten, bei denen ein Boot-USB-Stick mitgeliefert^ wird.

Werkzeug

Feinmechanik-Werkzeugset^

ca. 13€

Inhalt dieses Specials

- Teil 1 – Einleitung & Überblick

- Teil 2 – Gehäuse & Netzteil einbauen

- Teil 3 – Prozessor & Kühler einbauen

- Teil 4 – Arbeitsspeicher & Festplatte einbauen

- Teil 5 – Mainboard einsetzen

- Teil 6 – Grafikkarte einbauen und Netzteil verkabeln

- Teil 7 – DVD-Laufwerk und HDD-Festplatte einbauen

- Teil 8 – Geräte anschließen, erster Start, BIOS und Windows-Setup

- Teil 9 – Benchmark-Leistungstest mit Blender

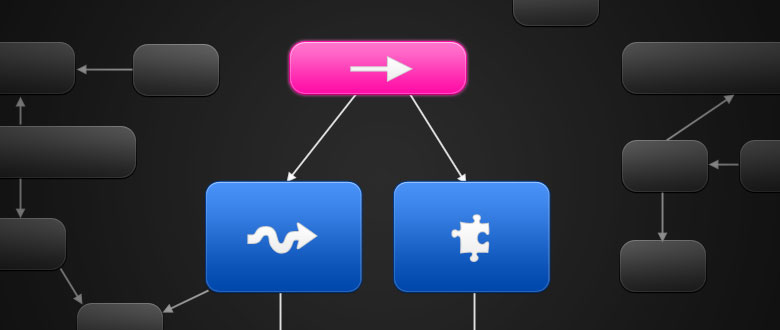

“ /> mein Favorit“]Das Fungus VST wirkt auf den ersten Blick wie ein super simples Programmier-Tool für Kinder. Die Beispiele sind sehr auf Linearität und Dialog-basierte Spiele ausgelegt und die grafischen Vorlagen weisen einen sehr speziellen Stil auf, der zu vielen Projekten vermutlich nicht passt. Dennoch halte ich dieses System derzeit für eines der besten kostenlosen VSTs für Unity! Hinter den Beispielen – die man mögen kann oder nicht – steckt eine mächtige Visual Scripting-Engine mit aufgeräumter Oberfläche, die Ablaufdiagramme sowie auch Sequenzlisten unterstützt. Die mitgelieferten Befehle sind umfangreich, eigene Erweiterungen möglich, zumal es sich um ein sehr gepflegtes und ständig weiterentwickeltes quelloffenes Projekt handelt. Es gibt eine gute Dokumentation, Tutorials und Videos, die den Einsteig leicht machen. Obwohl auch schon auf Unity-Konferenzen vorgestellt, findet das Projekt noch relativ wenig Beachtung. [/linktipp]

“ /> mein Favorit“]Das Fungus VST wirkt auf den ersten Blick wie ein super simples Programmier-Tool für Kinder. Die Beispiele sind sehr auf Linearität und Dialog-basierte Spiele ausgelegt und die grafischen Vorlagen weisen einen sehr speziellen Stil auf, der zu vielen Projekten vermutlich nicht passt. Dennoch halte ich dieses System derzeit für eines der besten kostenlosen VSTs für Unity! Hinter den Beispielen – die man mögen kann oder nicht – steckt eine mächtige Visual Scripting-Engine mit aufgeräumter Oberfläche, die Ablaufdiagramme sowie auch Sequenzlisten unterstützt. Die mitgelieferten Befehle sind umfangreich, eigene Erweiterungen möglich, zumal es sich um ein sehr gepflegtes und ständig weiterentwickeltes quelloffenes Projekt handelt. Es gibt eine gute Dokumentation, Tutorials und Videos, die den Einsteig leicht machen. Obwohl auch schon auf Unity-Konferenzen vorgestellt, findet das Projekt noch relativ wenig Beachtung. [/linktipp]